在人工智能浪潮席卷全球的今天,深度学习作为其核心驱动力,正以前所未有的速度改变着各行各业。对于许多初学者甚至是有一定经验的开发者而言,深度学习的开发与部署往往被视为一项复杂且门槛较高的任务,涉及复杂的数学理论、庞大的计算资源和繁琐的工程实践。但事实上,只要用对方法和工具,掌握关键的“基础资源”与“核心技术”,开发与部署深度学习模型的过程可以变得清晰、高效甚至充满乐趣。

一、 夯实基础:不可或缺的人工智能资源

成功的深度学习项目始于对基础资源的清晰认知与合理利用。这些资源构成了项目开展的基石。

- 计算资源:从CPU到云服务

- 硬件选择:模型训练是计算密集型任务。虽然入门时可以使用个人电脑的CPU进行小规模实验,但处理真实数据集和复杂模型(如卷积神经网络CNN、Transformer)时,GPU(图形处理器) 因其强大的并行计算能力成为首选。如今,NVIDIA的CUDA生态提供了广泛支持。对于更大规模的任务,TPU(张量处理单元) 等专用芯片提供了更高的效率。

- 云端算力:个人购置高端GPU成本高昂。各大云服务商(如AWS、Google Cloud、Azure,以及国内的阿里云、腾讯云等)提供了按需使用的GPU/TPU实例,使得算力获取变得灵活且可扩展,极大地降低了入门和实验的成本。

- 数据资源:模型的“食粮”

- 数据获取与清洗:高质量的数据集是模型成功的先决条件。除了自行收集标注数据,充分利用公开数据集(如ImageNet、COCO、MNIST,以及Kaggle平台上的各类数据集)能加速原型验证。数据清洗、增强(Data Augmentation)和标准化是提升模型泛化能力的关键步骤。

- 数据管理工具:使用工具(如Pandas、DVC)对数据集进行版本管理和预处理流水线构建,能确保实验的可复现性。

- 软件与框架:开发者的“利器”

- 主流深度学习框架:TensorFlow 和 PyTorch 是目前最主流的两个框架。PyTorch以其动态计算图和直观的编程接口深受研究人员喜爱;TensorFlow则在生产部署和移动端支持方面有强大生态。选择哪个框架往往取决于项目需求和个人偏好,但掌握其中一个足以应对大部分场景。

- 辅助工具链:Jupyter Notebook 用于交互式开发和展示;Anaconda 或 Docker 用于管理复杂的依赖环境和容器化部署;Git 用于代码版本控制。

二、 掌握核心:简化开发与部署的技术流程

有了资源,如何高效地将其串联起来?以下技术流程是简化工作的关键。

- 模型开发:从构思到训练

- 原型快速构建:利用框架的高级API(如TensorFlow的Keras、PyTorch的TorchVision)可以像搭积木一样快速构建网络结构,无需从零开始编写每一层。

- 迁移学习:这是“用对方法”的典范。无需在海量数据上从头训练庞大模型,只需在预训练模型(如在ImageNet上训练好的ResNet、VGG)基础上,针对自己的特定任务进行微调(Fine-tuning),即可用较少的数据和算力获得优异性能。

- 自动化调优:超参数(学习率、批大小等)的调整曾令人头疼。现在,可以利用 自动化机器学习(AutoML) 工具,如Keras Tuner、Ray Tune,或云平台提供的AutoML服务,让系统自动搜索最优参数组合。

- 模型部署:从实验到生产

- 模型优化与转换:训练好的模型通常体积庞大、推理慢。通过模型剪枝、量化(将高精度浮点数转换为低精度整数,如FP32到INT8)和知识蒸馏等技术,可以大幅压缩模型尺寸、提升推理速度,同时尽量保持精度。框架也提供了相应的工具(如TensorFlow Lite、PyTorch Mobile)。

- 选择部署方式:

- 服务器端部署:将模型封装为RESTful API服务,使用Flask、FastAPI等Web框架,或专门的推理服务器(如TensorFlow Serving、TorchServe),供其他应用程序调用。

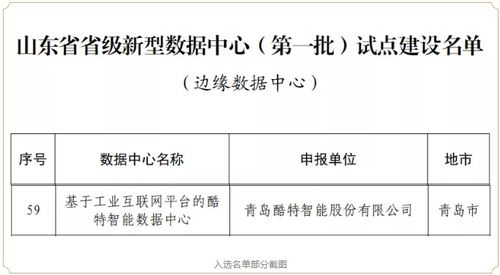

- 边缘端部署:将优化后的模型直接部署到手机、摄像头、嵌入式设备(如Jetson系列)上,实现低延迟、隐私保护的本地推理。

- 云原生部署:利用Docker容器将模型及其环境打包,通过Kubernetes进行编排管理,实现高可用、可伸缩的云上服务。

3. 持续迭代:MLOps的引入

将软件工程的DevOps理念引入机器学习,形成MLOps,是实现深度学习项目持续、稳定交付的关键。它包括自动化训练流水线、模型版本管理、性能监控、漂移检测和自动化重新训练等环节。使用MLflow、Kubeflow等平台可以系统地管理整个机器学习生命周期。

###

深度学习并非遥不可及的“黑魔法”。通过系统性地理解和运用基础资源(弹性算力、优质数据、成熟框架),并遵循高效的技术流程(快速原型、迁移学习、模型优化、灵活部署),开发与部署的复杂度将大大降低。关键在于“用对方法”——善于利用现有的强大工具和最佳实践,将精力聚焦于解决真正的业务问题,而非重复发明轮子。当资源与技术形成合力,探索人工智能的奥秘之路,便会越走越宽,越走越简单。